วันนี้พี่เพิ่งได้รับของที่สั่งจาก Seed Studio มา นั่นก็คือเซ็นเซอร์จับท่าทางแบบอินฟราเรด (Grove smart IR Gesture sensor) ตัวนี้แหละ กล่องแพ็คเกจสวยงามมาก แถมมีเอกสารข้อมูลพื้นฐานมาให้ด้วย

โมดูลนี้ค่อนข้างใหม่เลย พี่เลยจะลองทำเป็นอุปกรณ์ใช้งานจริงสักชิ้น เพื่อโชว์ศักยภาพของมันด้วยไมโครคอนโทรลเลอร์ให้ดู ในระหว่างทดสอบและพัฒนาพี่จะใช้ยูทิลิตี้, ไลบรารี่, และคำแนะนำจากแหล่งข้อมูลต่างๆ มาช่วย

ภาพรวมโปรเจค

"Gesture-Logic" นี่คือการสำรวจขั้นสูงในด้าน นิติวิทยาศาสตร์ภาพจากเครื่อง (Machine-Vision Forensics) และ การออกแบบอินเตอร์เฟซมนุษย์-เครื่องแบบไม่สัมผัส (Contactless HMI Design) โปรเจคนี้ไม่ได้ใช้เซ็นเซอร์อินฟราเรดแบบเดิมๆ ที่อาศัยแค่การเปลี่ยนแปลงของแอมพลิจูด แต่ใช้ โมดูลกล้องอินฟราเรดอัจฉริยะ PAJ7660 แทน โดยการรวมเซ็นเซอร์ภาพ IR เฉพาะเข้ากับอัลกอริทึม AI บนชิป ทำให้ Gesture-Logic สามารถจำแนกการเคลื่อนไหวมือที่แตกต่างกันได้มากกว่า 15 แบบ ด้วยความแม่นยำระดับสูง ระบบนี้เป็นเหมือนพิมพ์เขียวสำหรับอินเตอร์เฟซรุ่นใหม่ในวงการแพทย์, การควบคุมในรถยนต์, และการโต้ตอบกับหุ่นยนต์ที่ใช้งานง่าย

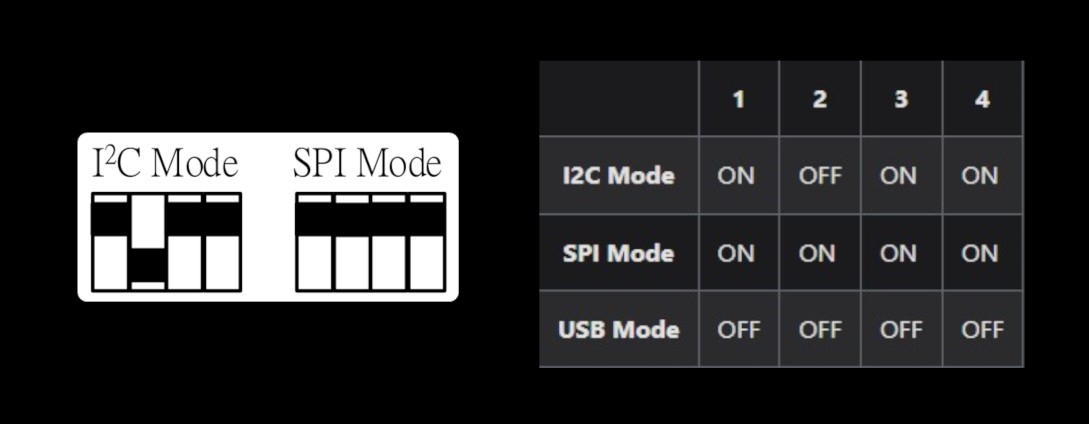

สำหรับไมโครคอนโทรลเลอร์ พี่วางแผนจะใช้ Arduino Nano ส่วนด้านหลังของโมดูล Gesture sensor มีสวิตช์ไมโครอยู่ 4 ตัว ใช้สำหรับเปลี่ยนโหมดการสื่อสารระหว่าง I2C, SPI, และ USB ได้

ลงลึกเรื่องเทคนิค

- นิติวิทยาศาสตร์กล้อง IR PAJ7660:

- เครื่องยนต์สร้างภาพ: PAJ7660 ทำงานโดยการจับภาพขาวดำความเร็วสูงในสเปกตรัมอินฟราเรด เมื่อมือเคลื่อนที่ผ่านเขตที่ตรวจจับได้ AI บนชิปจะวิเคราะห์การเคลื่อนที่ของกลุ่มความร้อน (พิกเซล) เพื่อคำนวณเวกเตอร์การเคลื่อนไหว หลักนิติวิทยาศาสตร์แบบนี้ทำให้เซ็นเซอร์สามารถแยกแยะระหว่างการเคลื่อนไหวซับซ้อนอย่าง "หมุนตามเข็มนาฬิกา" กับการ "ปัด" แบบง่ายๆ ซึ่งเซ็นเซอร์แบบโฟโตไดโอดธรรมดาจะสับสนได้

- การดึงคุณลักษณะด้วย AI: อัลกอริทึมฝังตัวจะทำการดึงคุณลักษณะแบบเรียลไทม์, ระบุจำนวนนิ้วและทิศทางของฝ่ามือ โปรเจคนี้จะแสดงวิธีการรับค่า "ธงสัญญาณท่าทาง (Gesture Flags)" เหล่านี้ผ่านการสื่อสารแบบ I2C โดยที่ Arduino Nano จะไปถามข้อมูลจากรีจิสเตอร์แมปของเซ็นเซอร์เพื่อดึงค่าการเคลื่อนไหวล่าสุดที่ถูกจำแนกแล้ว

- การวินิจฉัยบัสหลายโปรโตคอล:

- การสลับบริดจ์ทางฮาร์ดแวร์: คุณสมบัติพิเศษของ PAJ7660 คือสวิตช์ไมโคร 4 ตัวที่รวมมาให้ นี่คือ การสลับโปรโตคอลทางกายภาพ (Physical Protocol Forensics) ช่วยให้นักพัฒนาสามารถสลับระหว่าง I2C (สำหรับลอจิกฝังตัวมาตรฐาน), SPI (สำหรับบันทึกข้อมูลความเร็วสูง), และ USB (สำหรับการวินิจฉัยกับ PC โดยตรง) ได้โดยไม่ต้องเปลี่ยนเฟิร์มแวร์ภายในชิป

- การจำลอง USB HID: โดยการตั้งสวิตช์ทั้งสี่ในตำแหน่ง "OFF" โมดูลจะเข้าสู่โหมด USB-CDC ซึ่งช่วยให้สามารถดูภาพการตรวจจับได้โดยตรงบน Windows โดยใช้ซอฟต์แวร์ Gesture Demo ทำให้นักพัฒนาสามารถปรับความไวในการตรวจจับและขอบเขตมุมมอง (FOV) ได้ก่อนจะนำไปใช้กับไมโครคอนโทรลเลอร์แบบสแตนด์อโลน

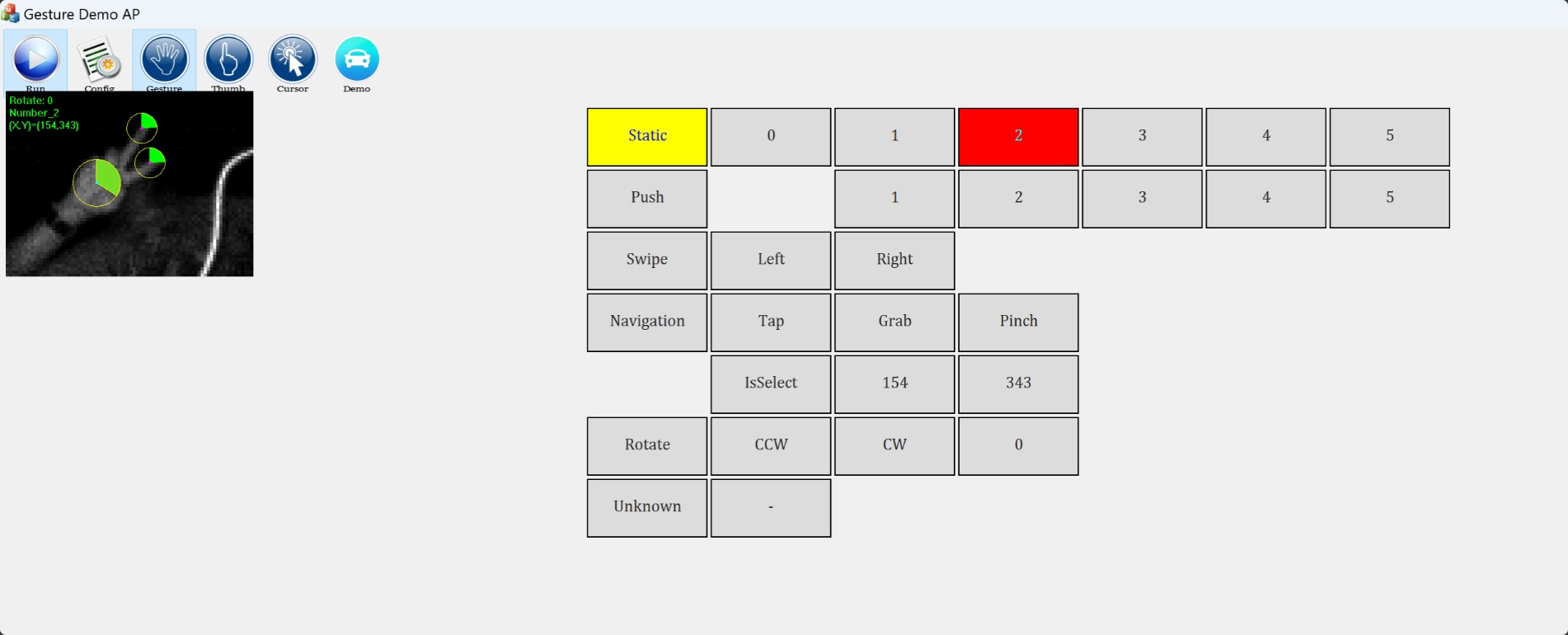

วิธีที่เร็วและง่ายที่สุดในการทดสอบเซ็นเซอร์และฟังก์ชันพื้นฐานคือใช้แอปพลิเคชัน Gesture Demo บน Windows ที่ทางผู้ผลิตเตรียมมาให้

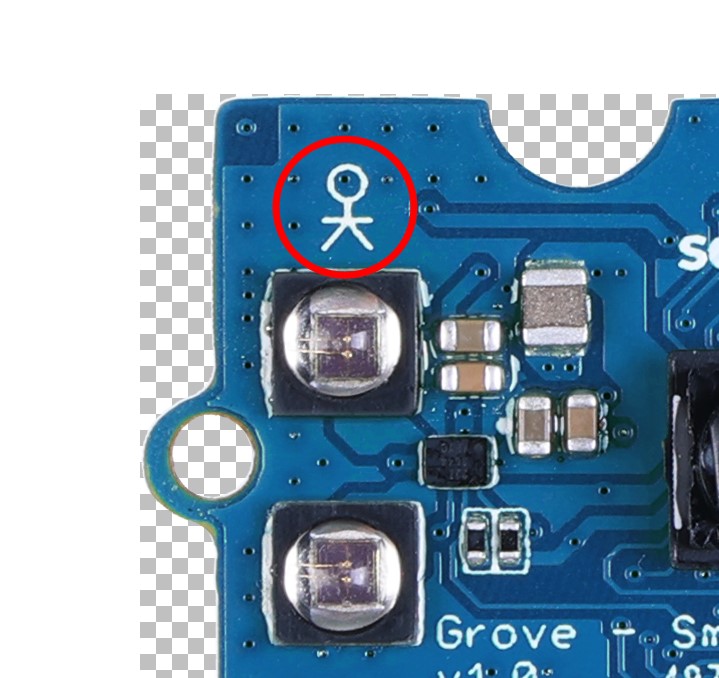

เพื่อการนี้ โมดูลควรถูกตั้งค่าในโหมด USB ซึ่งหมายความว่าสวิตช์ไมโครทั้งสี่ตัวควรอยู่ในตำแหน่ง OFF ด้านหน้าของเซ็นเซอร์ มุมซ้ายบนจะมีรูปคนเล็กๆ ถ้าน้องเห็นรูปคนยืนตั้งตรง แสดงว่าวางโมดูลถูกตำแหน่งแล้วนะ อย่าเอามันนอนตะแคงล่ะ จัดไปวัยรุ่น!

ทีนี้เราก็ต้องเอาเซ็นเซอร์จับท่าทาง (Grove Gesture Sensor) ต่อเข้ากับ PC กันหน่อย เปิดแอปพลิเคชันขึ้นมา แล้วกดปุ่ม RUN ที่มุมซ้ายบนของซอฟต์แวร์ จากนั้นเลือกโหมด Gesture เพื่อดูผลลัพธ์แบบเรียลไทม์เลย

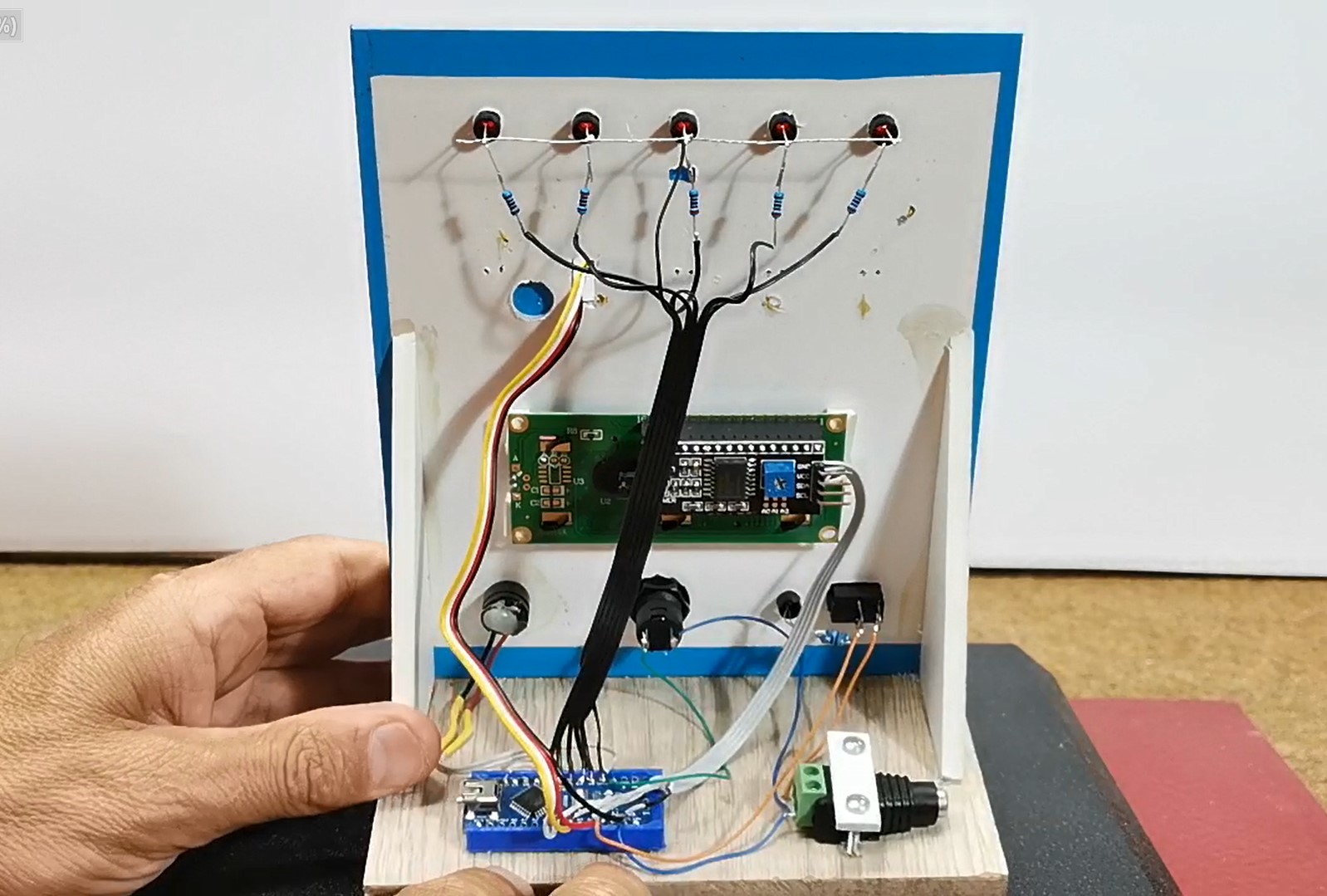

ต่อไป พี่จะพาน้องไปดูวิธีสร้างอุปกรณ์ที่ทำงานได้เอง ด้วยไมโครคอนโทรลเลอร์ Arduino นี่คือตัวอย่างที่ง่ายที่สุด ที่จะแสดงท่าทางที่จับได้บนหน้าจอ LCD เป็นตัวหนังสือ พร้อมกับเปิด LED ที่ตรงกับท่าทางนั้นๆ ด้วย LED พวกนี้เอาไปเปลี่ยนเป็นรีเลย์เพื่อควบคุมกระบวนการอื่นๆ หรือสั่งงานอะไรตามที่เราต้องการได้สบายๆ พูดง่ายๆ ก็คือ แค่โค้ดง่ายๆ แบบนี้ เพิ่มเติมนิดหน่อย เราก็สร้างอุปกรณ์เจ๋งๆ ได้แล้ว โค้ดพื้นฐานนี่พี่ก็หยิบมาจากเว็บ Seed Studio ที่บอกไว้ข้างบนนั่นแหละ การเขียนโค้ดไม่ใช่สเปคพี่ซะทีเดียว ดังนั้นพี่มั่นใจว่ามันน่าจะทำให้ง่ายกว่านี้ได้อีก แต่ที่สำคัญคือมันใช้งานได้เป๊ะเวอร์ ถ้าน้องมีพื้นฐาน ก็ลองปรับแต่งหรือทำให้มันกระชับขึ้นได้ตามสบายเลย

วิศวกรรมและการนำไปใช้

- ฮาร์มอนิกส์ของ State-Machine สำหรับ HMI:

- ฟีดแบ็คภาพและเสียง: โปรเจคนี้ใช้ LCD 16x2 สำหรับแสดงผลข้อความ และใช้ LED หลายดวงเพื่อแสดงสถานะแบบคู่ขนาน ท่าทางที่ตรวจจับได้ (เช่น "ปัดซ้าย") จะกระตุ้นลอจิกของ state-machine เฉพาะตัว ทำให้ออดดังเพื่อยืนยัน และจุด LED ที่ตรงกัน เพื่อจำลองการควบคุมกระบวนการภายนอก (เช่น การสลับรีเลย์ หรือเปลี่ยนช่องทีวี)

- ความสมบูรณ์ของสัญญาณและฟลว์ของลอจิก:

- ลอจิกจำกัดกระแส: ใช้ตัวต้านทาน (Resistor) 1k โอห์ม กับ LED แต่ละดวง เพื่อให้แน่ใจว่าไม่เกินขีดจำกัดกระแสต่อพินของ Arduino Nano ป้องกันไม่ให้ชิป ATmega328p ร้อนจัดตอนตรวจจับหลายนิ้วพร้อมกัน

- การกำหนดที่อยู่บนบัส I2C: LCD และ PAJ7660 ใช้บัส I2C (

SDA/SCL) เดียวกัน ต้องจัดการความเร็วบัส (ปกติ 100kHz หรือ 400kHz) อย่างระมัดระวังเพื่อไม่ให้เกิดการชนกันของแพ็กเก็ตข้อมูล ขณะที่กำลังดึงข้อมูลท่าทางความเร็วสูง

- การปรับเทียบภาคสนาม:

- การตรวจสอบทิศทาง: ต้องติดตั้งเซ็นเซอร์โดยให้ไอคอน "รูปคน" ด้านในอยู่ในตำแหน่งตั้งตรง ถ้าปรับเทียบแกนนี้ผิด เวกเตอร์การเคลื่อนไหวจะสลับกัน (เช่น "ปัดขวา" อาจถูกตรวจจับเป็น "ปัดซ้าย")

อุปกรณ์ทั้งหมดนี่เรียบง่ายมาก มีแค่ส่วนประกอบไม่กี่ชิ้น:

- ไมโครคอนโทรลเลอร์ Arduino

- จอแสดงผล LCD แบบ I2C ขนาด 16x2 ตัวอักษร

- LED 5 ดวง พร้อมตัวต้านทานที่เหมาะสมสำหรับควบคุมกระแส

- ออด (Buzzer)

- และ Grove Smart IR Gesture Sensor จาก Seed Studio

เริ่มแรกเราจะทดสอบการนับนิ้ว โดยจำนวน LED ที่ติดจะขึ้นกับจำนวนนิ้วที่ตรวจจับได้ ต่อไปคือการปัด (Swipe) ซึ่งตรวจจับทิศทางการเคลื่อนไหวของมือ ตัวอย่างเช่น เราเอาไปใช้เลื่อนรูปในอัลบั้ม เปลี่ยนช่องทีวี หรือเปลี่ยนเพลงในเพลย์ลิสต์ได้เลย และอีกหนึ่งการทดสอบที่พี่ว่าน่าสนใจที่สุด คือการหมุนตามเข็มและทวนเข็มนาฬิกา อย่างที่เห็นในวิดีโอ คำสั่งที่ทำงานจะแสดงผลบน LCD Display ตลอดเวลา

และสุดท้าย สรุปสั้นๆ ง่ายๆ:

โมดูลเล็กๆ นี้เป็นอุปกรณ์จับท่าทางอัจฉริยะ ที่มีเซ็นเซอร์กล้องอินฟราเรดและใช้อัลกอริทึม AI สามารถตรวจจับท่าทางได้มากกว่า 15 แบบ พร้อมระยะตรวจจับที่กว้าง และรองรับการสื่อสารทั้ง IIC และ SPI ในวิดีโอนี้ พี่ได้แสดงวิธีควบคุมโมดูลแบบง่ายที่สุดไว้แล้ว เพื่อให้น้องๆ ได้ต่อยอดไอเดียและสร้างอุปกรณ์ตามความต้องการของตัวเองได้ ส่วนโมดูลนี้หาซื้อได้ที่ร้าน Seed Studio ในราคาที่เข้าถึงได้

Gesture-Logic แสดงให้เห็นถึงพลังของ Embedded AI Diagnostics อย่างชัดเจนเลยนะน้อง! ด้วยการเชี่ยวชาญ PAJ7660 IR-Camera Forensics และ Multi-Protocol Switching ทำให้ mircemk สร้าง HMI node ที่โหดมากๆ ขึ้นมา มันเป็นสะพานเชื่อมระหว่างเซ็นเซอร์แบบธรรมดาๆ กับระบบ Computer Vision แบบซับซ้อนเลยล่ะ เรียกได้ว่าเป็นโซลูชั่นเบาๆ ประหยัดไฟ แต่ควบคุมด้วยท่าทางขั้นสูงได้เลย จัดไปวัยรุ่น!

Motion Intelligence: ฝึกฝนการวิเคราะห์ท่าทางผ่าน AI และกล้องอินฟราเรดให้ชำนาญ